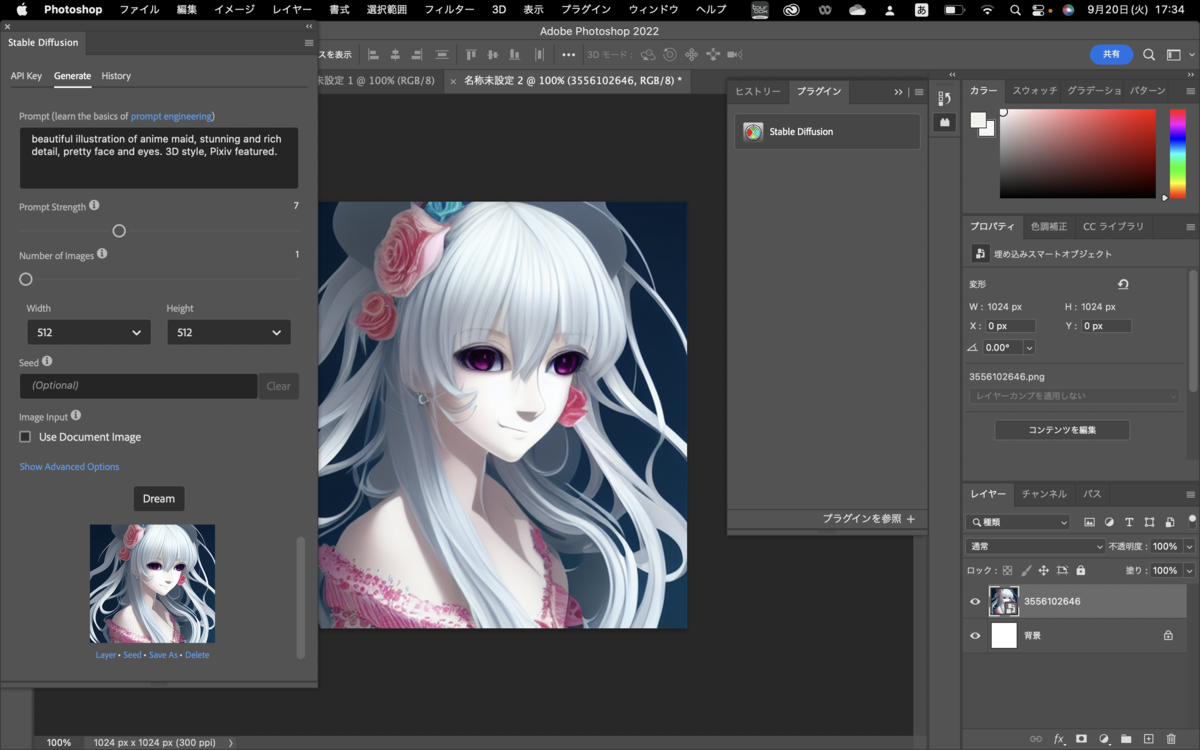

AI画像生成プロンプトの探索

AI画像生成プロンプトは世界中で研究されている。

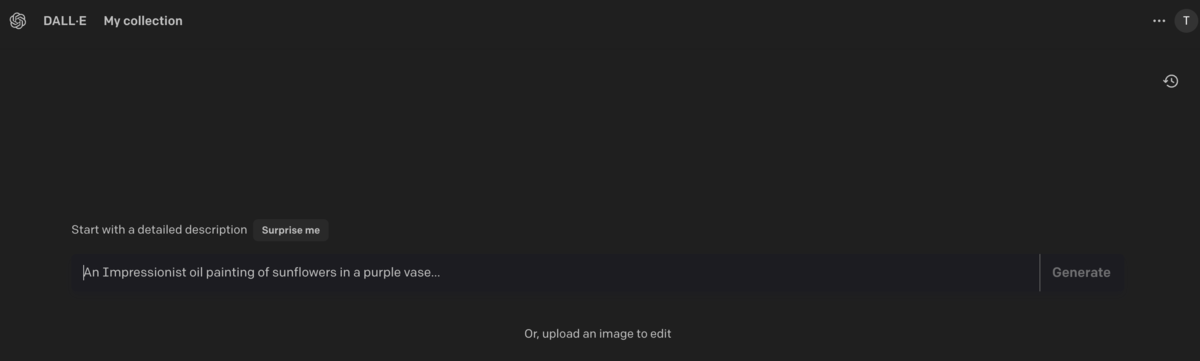

最初にプロンプトの概要を簡単にまとめる。こちらの概要はMidJourney,Stable Diffusion(DreamStudio),DALLE-2などのAI画像生成ツールで使える。

次にプロンプトの情報が閲覧できる優れたサイトを複数紹介する。

AI画像生成の手順

画像生成のプロンプトはどの様に打ち込んでいるだろうか。思いつくまま単語だけを入力しても生成されるが、狙ったイメージに近づけるにはお作法が求められる。

理想的な生成パターン

- 生成したい画像のイメージをまとめる

- 定形に従ってプロンプト(日本語)を書く(得意な方は英語で)

- 翻訳サイトでプロンプトを英文に変更(Google翻訳など活用)

- AI画像生成サイトにプロンプトを投入

- 繰り返し生成、あるいはプロンプトを修正して生成

- 納得のいく画像が生成されたら保存やアップロード

模倣する生成パターン

- 各AIサービスで他人が作成した生成物を閲覧

- 気に入ったものがあればコピー等して生成(プロンプトのコピー行為は問題ない)

- 繰り返し生成、あるいはプロンプトを修正して生成

- 納得のいく画像が生成されたら保存やアップロード

プロンプトの定形

プロンプトは複数の文節で構成される。諸先輩の方々が探究・整理されてきたプロンプトの定形は主に以下の様な8文節で構成されている。

- <参照>参照したい画像URL

- <様式>写真、油彩、水彩、漫画、アニメ、etc

- <主題>部屋にいる黒髪の笑顔の女性、古代の金属装飾品、etc

- <副題>古式の蝋燭立て、群衆など主題に添えるもの。複数OK

- <作風>作者名、作品名、ダークなど雰囲気、etc

- <設定>ライティング、リアル、4k8k、etc

- <機材>カメラ名、レンズ、フィルター、etc

- <付記>各AIサイトのオプション類

もちろん、主題の「女性」、だけでも画像は生成されるが制約条件がほとんどないので、意図したイメージにはなりにくい。そこで前記の8文節をしっかりと記載することで意図したイメージに近づけ易くなる。これは人間の画家でも、「女性を描いて欲しい!」と依頼しただけでは完成する作品がどんなものになるか予想出来ないのと同じだ。

では下記のプロンプトで生成してみよう。

- <参照> -

- <様式> a photo of

- <主題> beautiful woman playing piano

- <副題> and old candlestick

- <作風> Granblue Fantasy

- <設定> golden lighting

- <機材> Nikon D4 and Nikon Lens 50mm F1.4

- <付記> -

a photo of beautiful woman playing piano and old candlestick, Granblue Fantasy, golden lighting, Nikon D4 and Nikon Lens 50mm F1.4

a photo of beautiful woman playing piano and old candlestick, Granblue Fantasy, golden lighting, Nikon D4 and Nikon Lens 50mm F1.4

写真風、ピアノを弾く女性、蝋燭立て、グランブルーファンタジー(服装に影響)、金色の光源(ライトアップ)、一眼レフと開放レンズによるボケ、とプロンプトを細かく指定することで描きたいイメージに近い作例になったと感じる。

さて、作品を作る上で打ち込むプロンプトがどんな絵を生み出すかを一つずつ自分で調査するのも良いが、あまりにも変量が多いため、リファレンスを適宜活用した方が良いだろう。以下、有効なプロンプトを知る上で役立ちそうなサイトをいくつか紹介する。

プロンプト集①:MidJourneyの膨大なプロンプト実証

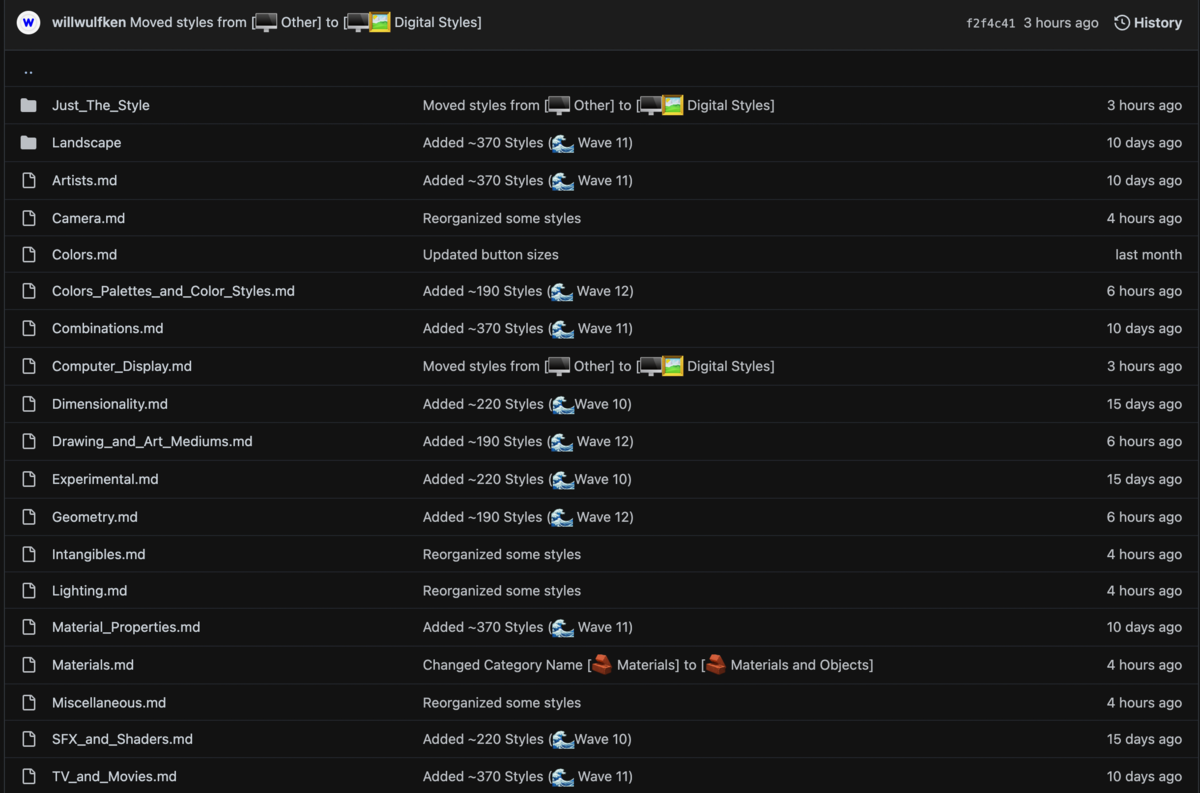

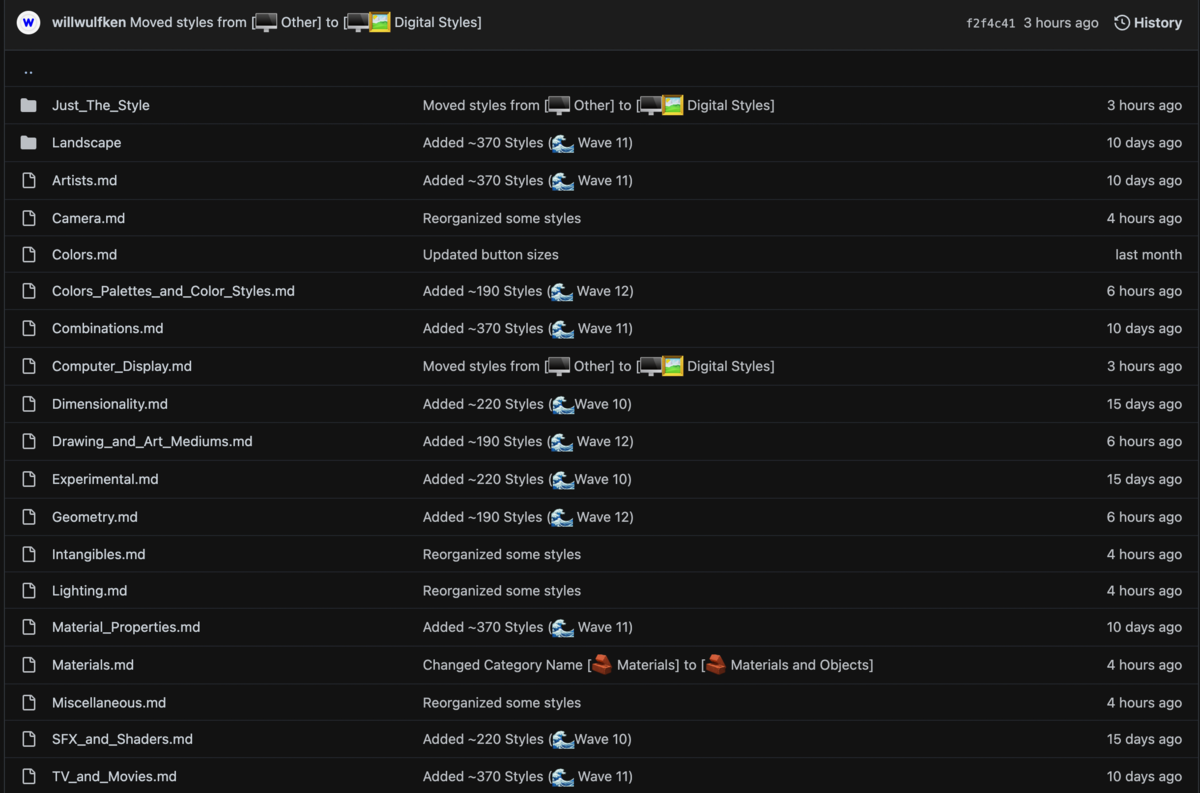

世の中にはとんでもないレベルでプロンプトの実証をしている方がいる。MidJourneyのVer.1,2,3の違い、僅かなプロンプトの違いなど、作例と共にまとめ上げているGitHubを最初に紹介する(下記リンク)。

github.com

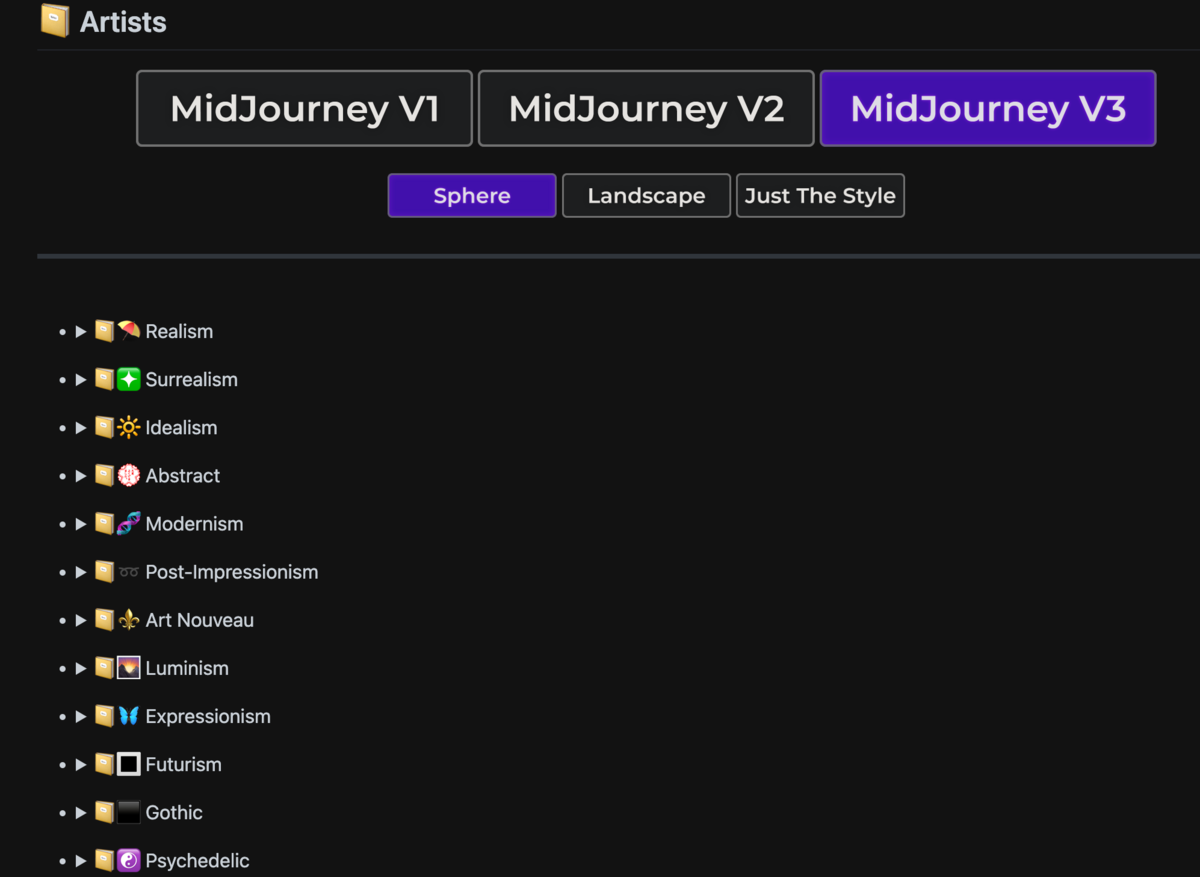

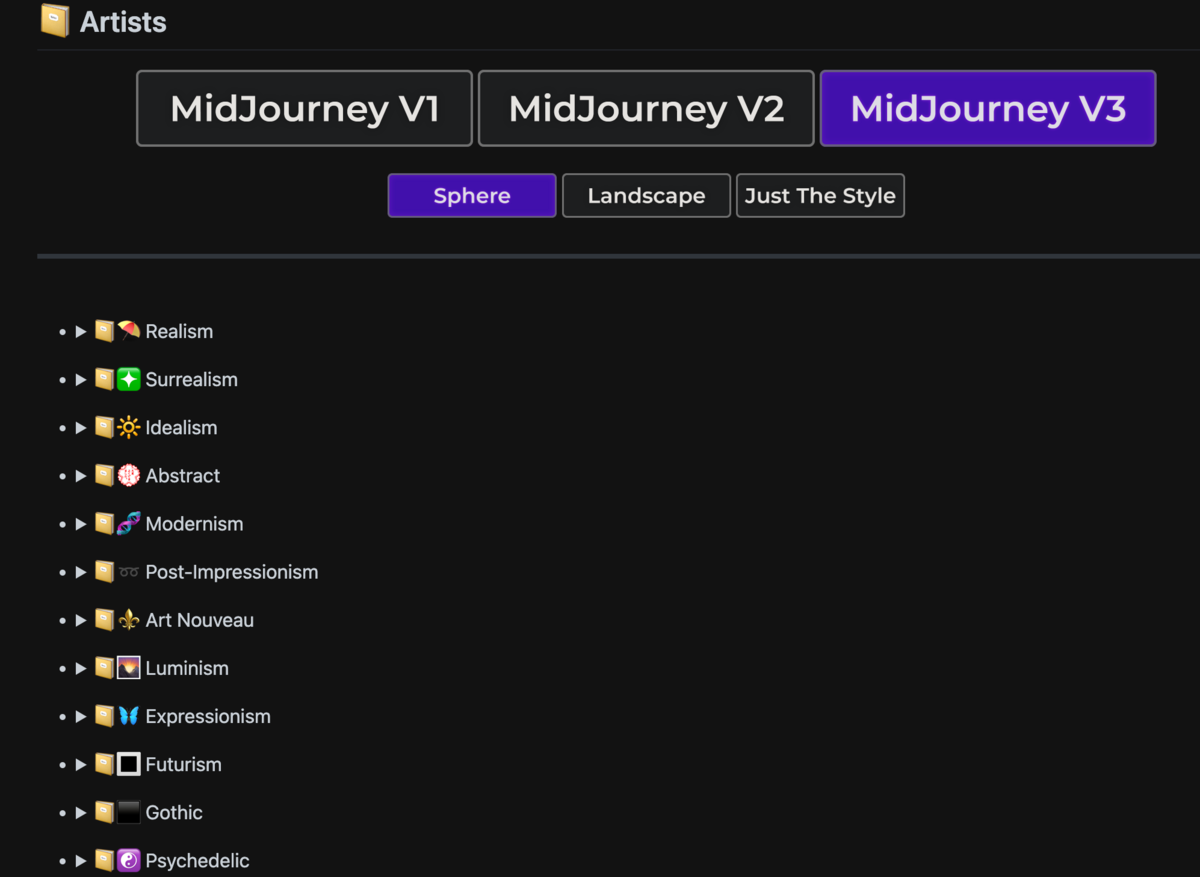

少し中を覗いてみよう。上にある「pages」フォルダをクリック、続いて「MJ_V3」、「Style_Pages」を順にクリックすると下記のスタイル一覧のページが出てくる。

各プロンプトのリスト

各プロンプトのリスト

ここに出ているスタイルリストの一つ一つがまた中に多数のリストを有している。例として先頭の「Artist」をクリックすると、写実派や近代アートなど様々な画風のリストが現れる

画風の一覧

画風の一覧

一番上に出てくる選択肢は「MidJourney V3」「landscape」(風景)を選んだ(他を選んでもOK)。

次にArtistリストの一番上にある「Realism」を選んでみよう。するとリアリズムの画風スタイルに属する9名の画家の名前をそれぞれプロンプトに入れた場合に生成される風景画のサンプルが表示される(表示される絵をクリックすると拡大される)。

画風 Realismの9名(画面上は5名まで見えている)

画風 Realismの9名(画面上は5名まで見えている)

同じ様に少し下の「Manga」の画風でもやってみる。

画風 Mangaの生成例

画風 Mangaの生成例

この様にArtist内で画風スタイルや画家の名前を入れ替えるだけで相当雰囲気が変わるのが見てとれる。このArtist以外に選択できるスタイル要素は最初のリストの通り、これまた膨大にある。例として「Lighting」ー「Types of lights」を選んでみる。

Style - Lighting - Just the style

Style - Lighting - Just the style

派手に変化するのがわかる。これだけ情報量があれば、色々眺めるだけでも勉強になるだろう。

プロンプト集②:ジャンル別の生成見本が手早く探せる

もう少し簡単にカタログの様に生成例が見たい場合はThe AI Artのサイトが便利かもしれない(下記リンク)。

www.the-ai-art.com

画面のメニューに従ってお好みの絵を探し、見つかったらタイトルの所をクリックするだけでプロンプトがコピー出来る。リンク先はAngleのリストから始まる。

The Ai Artサイト

The Ai Artサイト

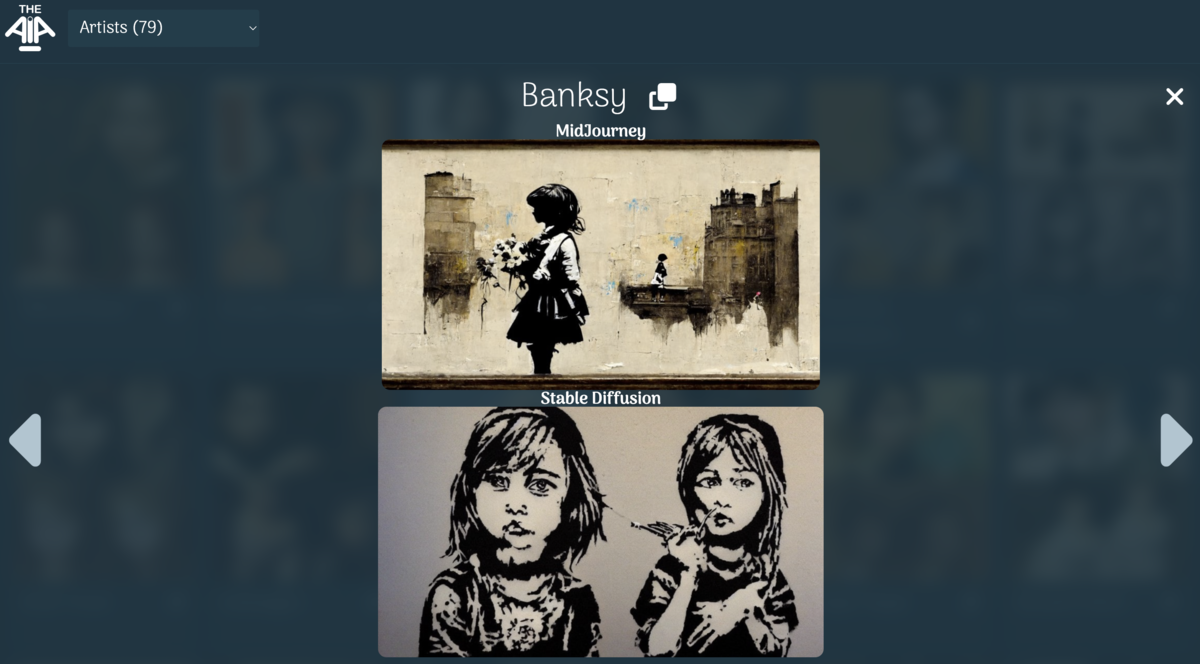

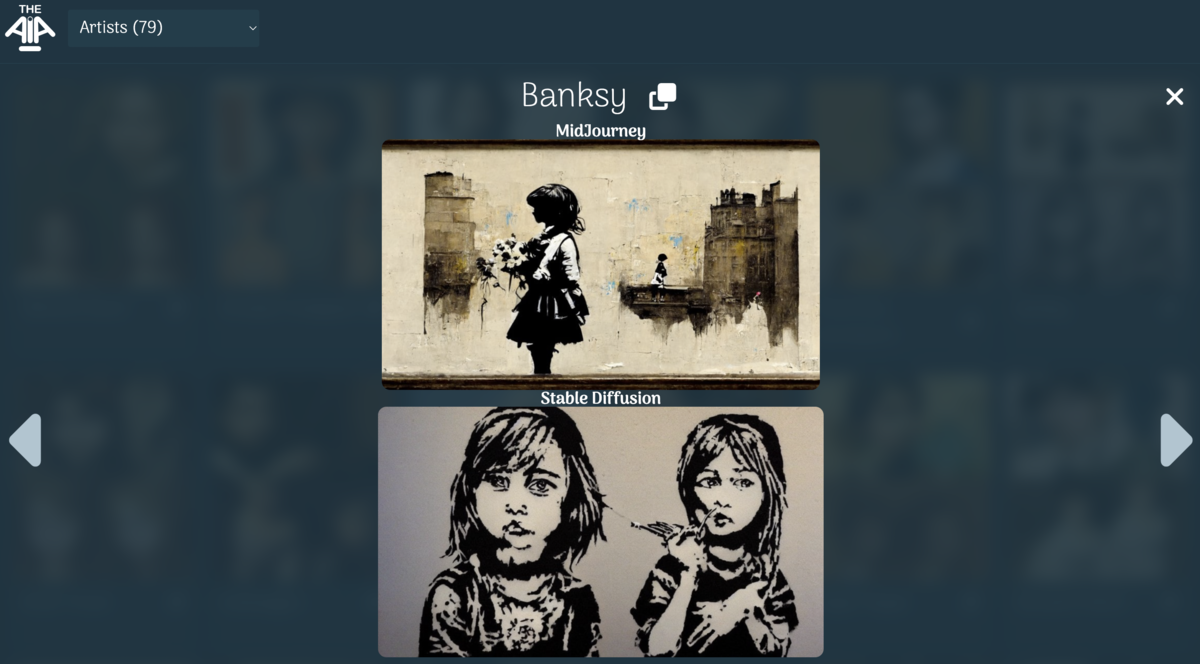

プルダウンメニューで「Artist」を選び、例えばバンクシーを選ぶと下の様に表示される。それぞれその画家名だけをMidJourney、Stable Diffusionに入力した生成例が示されるので気に入ればタイトルをクリックしてペーストすれば同様に生成される。

Artistでバンクシーを選んだ例

Artistでバンクシーを選んだ例

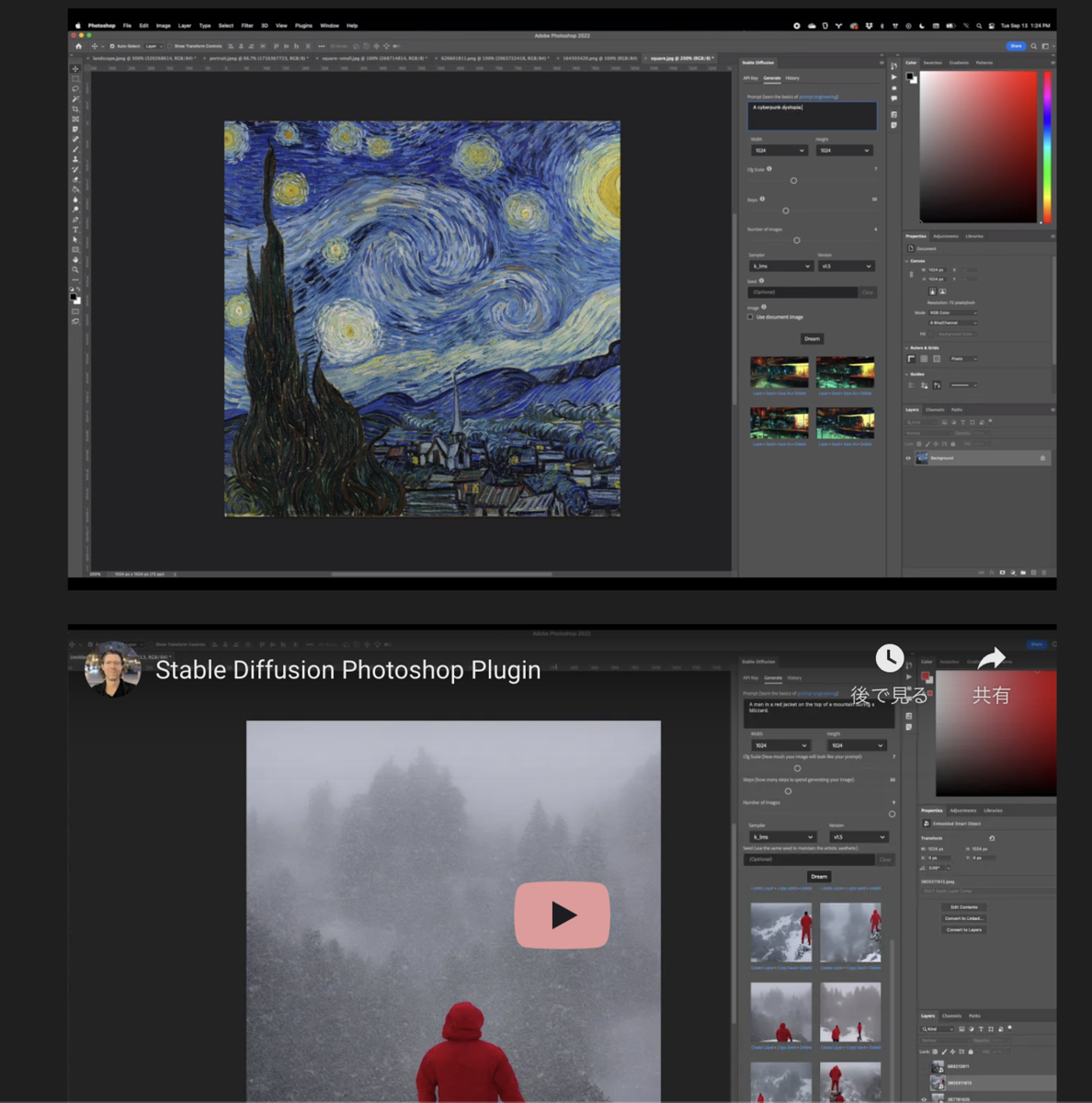

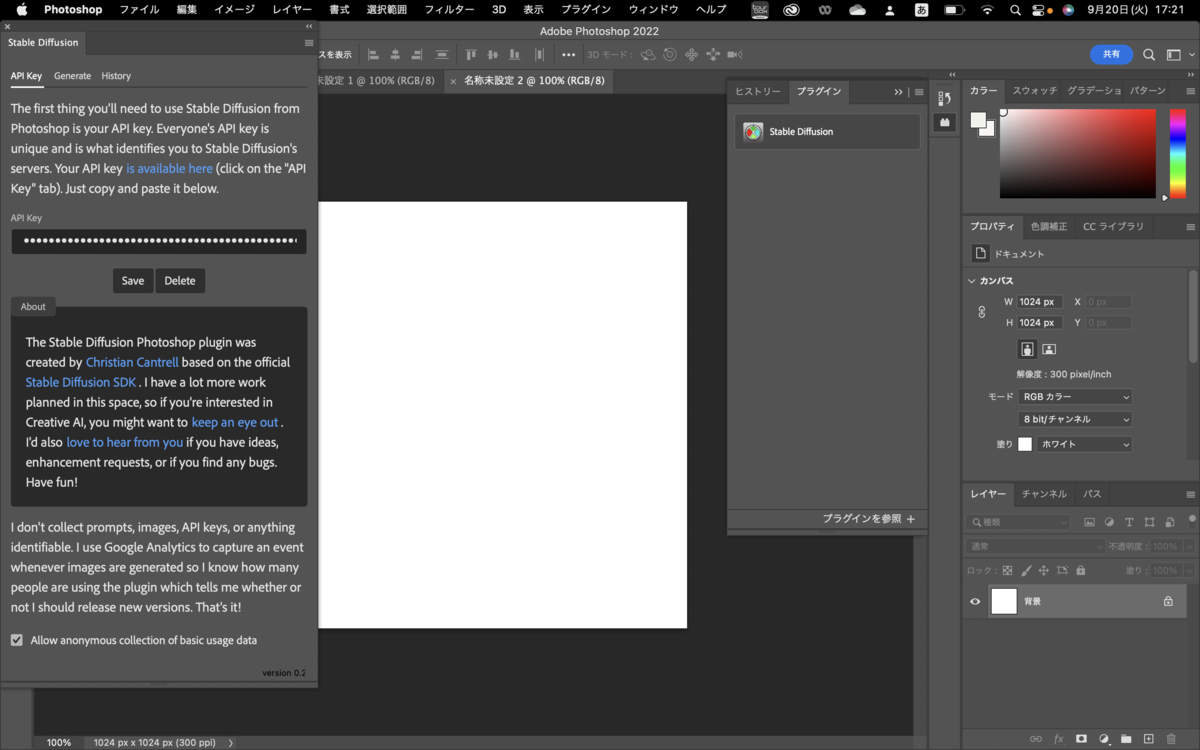

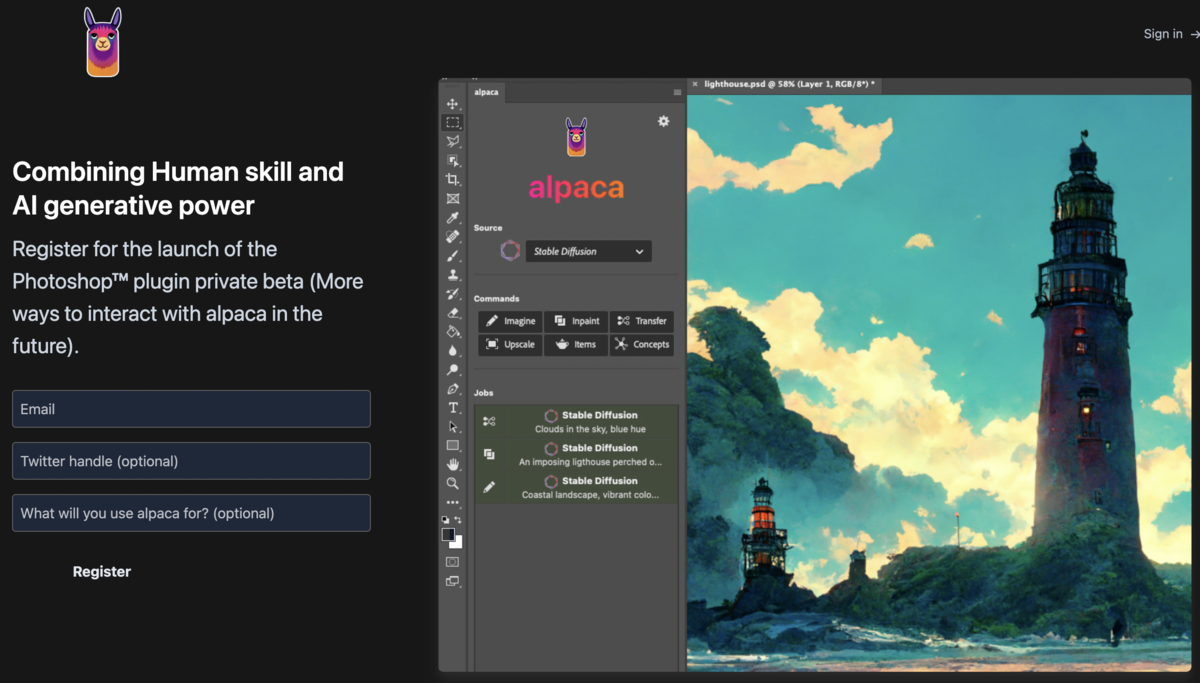

プロンプト集③:作り込まれたStable Diffusionの作成とプロンプトが分かる

Stable Diffusionの優れた作例がPinterestのように見れるサイトを2つ紹介。作品を作ったプロンプトもセットで手に入れられる。

lexica.art

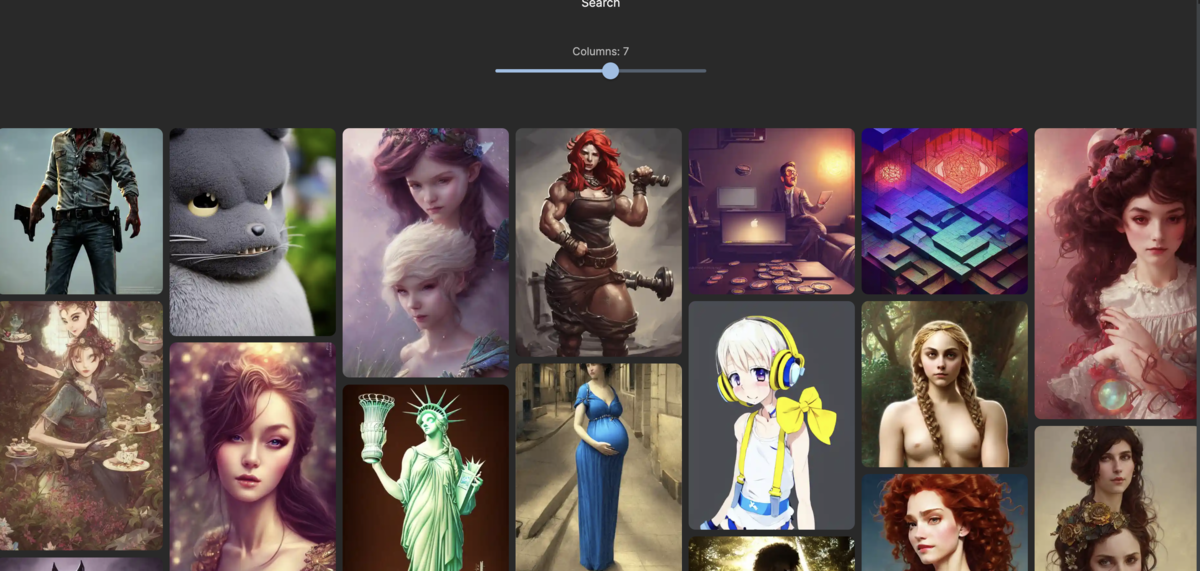

https://lexica.art/

リンクをクリックするとすぐに膨大な作例が見える。検索コマンドがあるので、作家名など入力すると容易に希望に近いものが探せるだろう。

KREA.ai

https://www.krea.ai/

こちらも同様

KREA.ai

KREA.ai

プロンプト集④:作り込まれたMidJourneyの作成とプロンプトが分かる

MidJourneyの作例はDiscordでも見えるが、MidJourneyサイトのCommunity Feedが検索機能を含め使い易いだろう。いずれの作品もプロンプトを確認できる(以下のリンク、有料会員のみ利用可能)。

https://www.midjourney.com/app/feed/all/

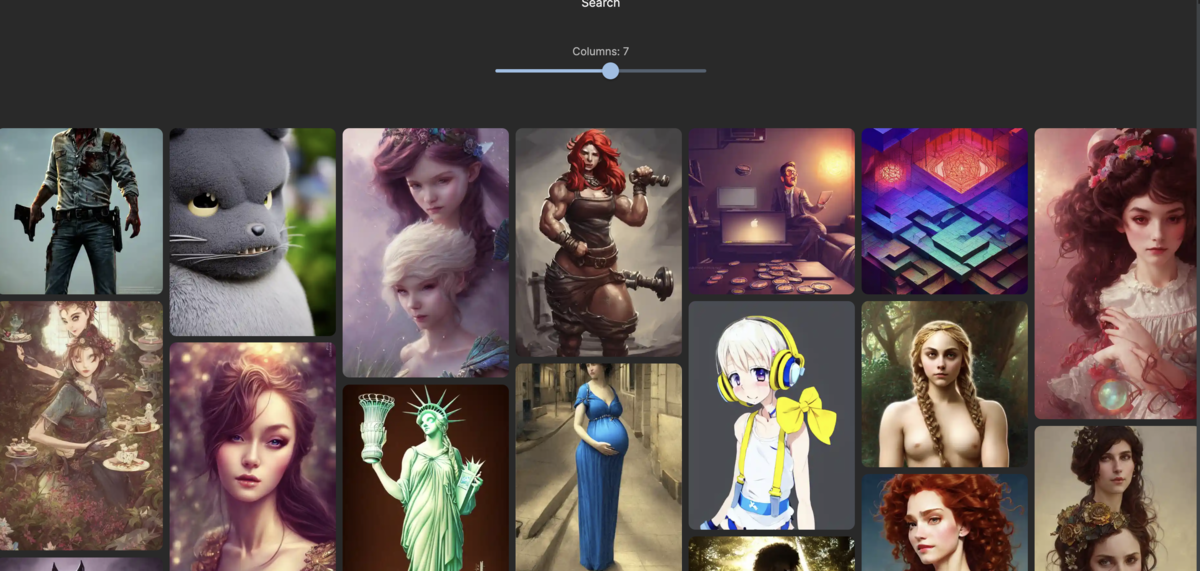

リンク先に移動すると膨大な作例があり、検索で見たい作例を探すのも容易だ(左上のSearch)。

MidJourney Community feed

MidJourney Community feed

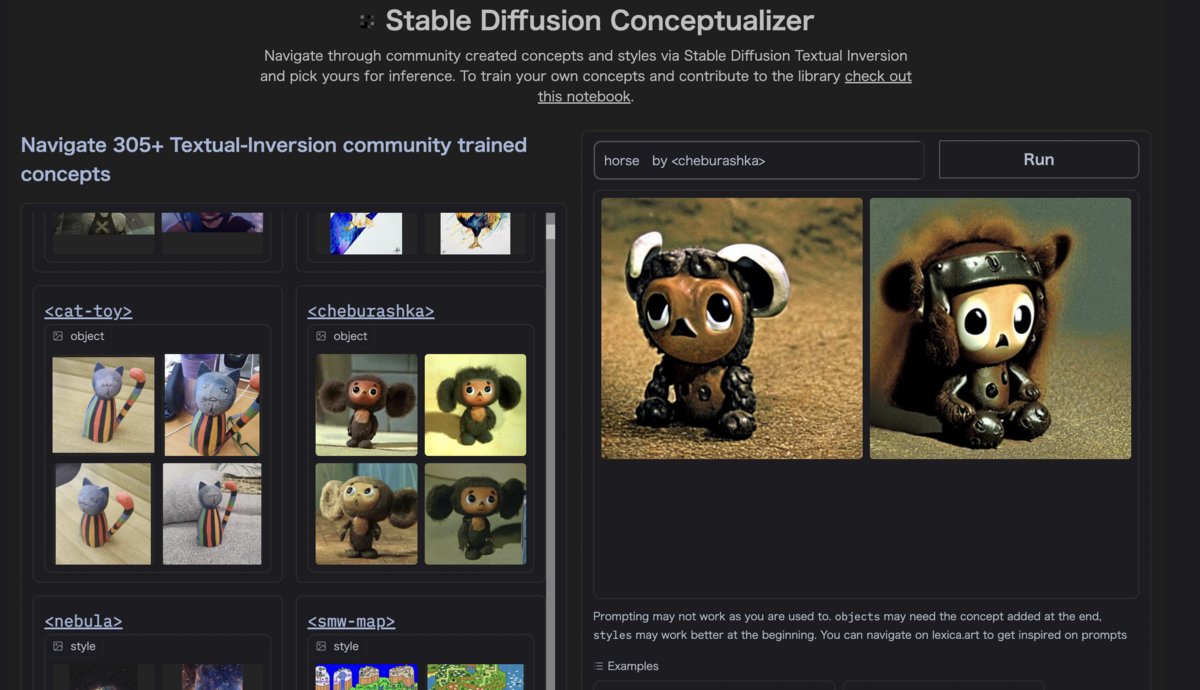

プロンプト集⑤:500名の偉大な画家名を入れた作例とプロンプトが分かる

Stable Diffusionに於ける優れた芸術家500名をプロンプト入力して生成される作風を確認できるサイト(下記リンク)。

www.urania.ai

プロンプトとしては「by < アーティスト名>」でOK。シンプルに好みのアーティストの画風を再現するのに便利だが、複数のアーティストを組み合わせて全く異なる作例を生み出すヒントとしても使えそう。下はゴッホとピカソの作例を出した状態

ゴッホとピカソを選んだ状態

ゴッホとピカソを選んだ状態

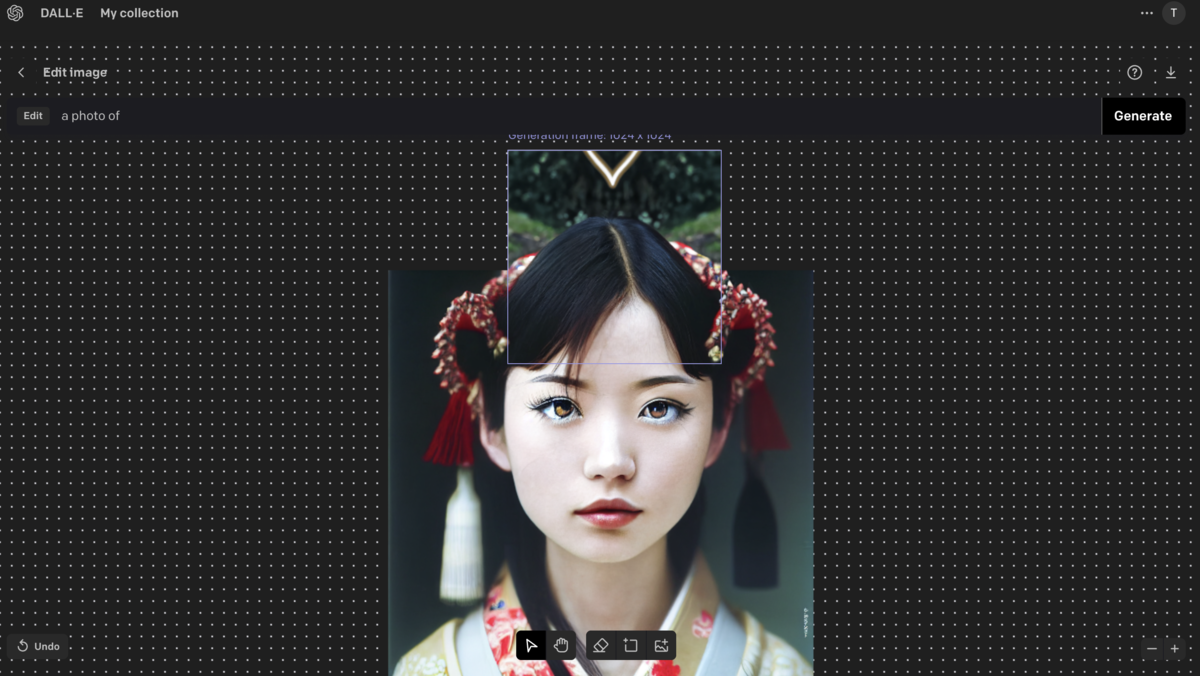

プロンプト集⑥:DALL-E2の作例とプロンプトが分かる

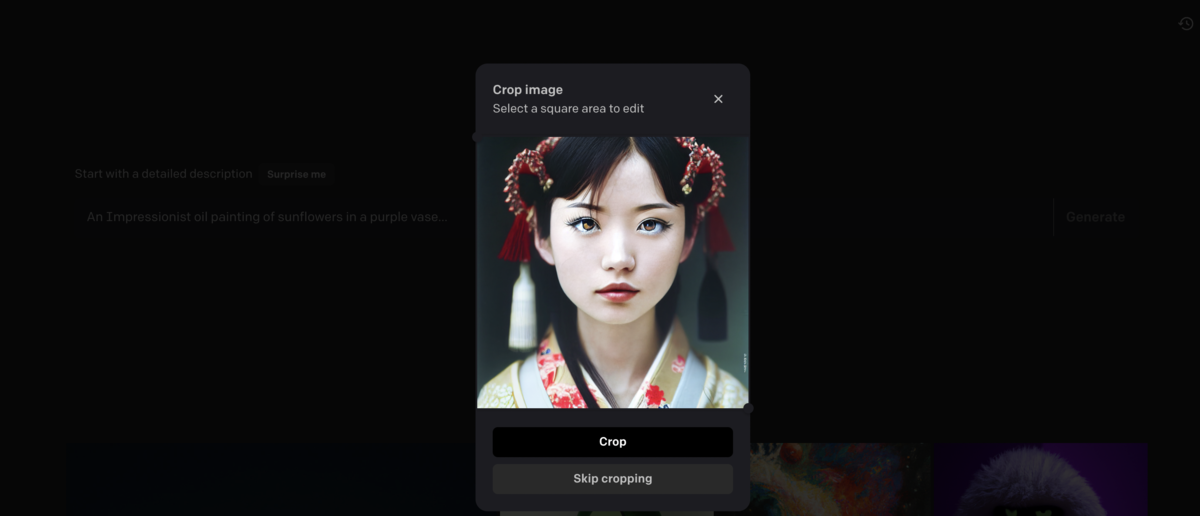

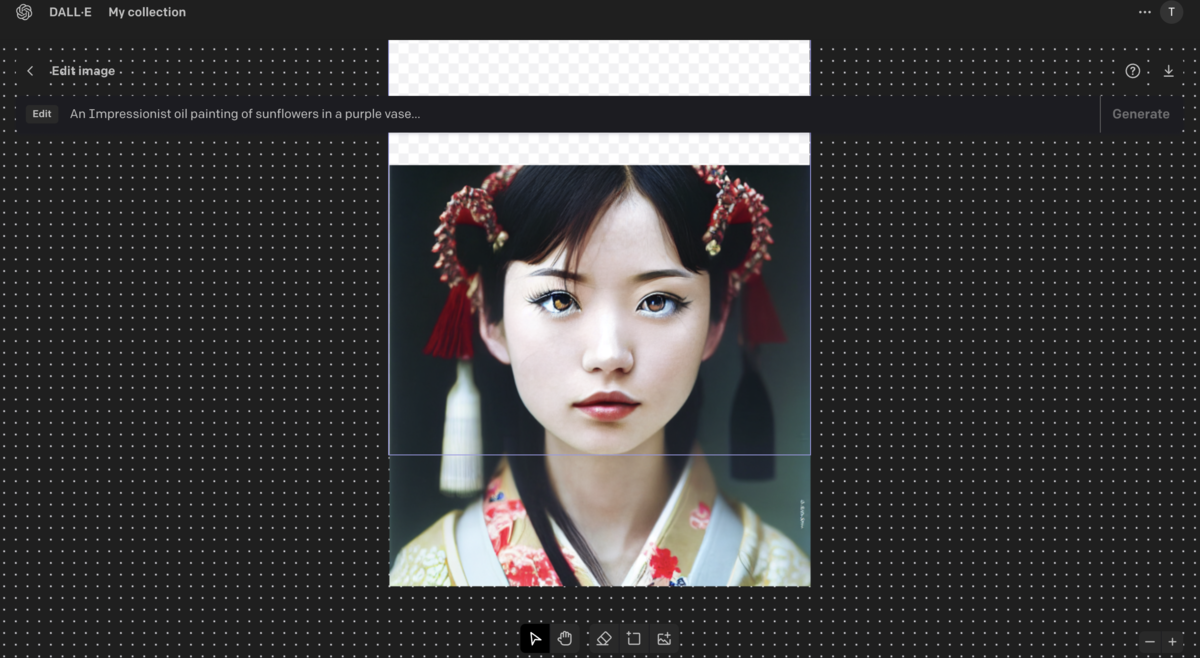

9/28にDALL-E2の待機リストが廃止され、誰でもすぐに使えるようになった(下記URL)

labs.openai.com

そのDALL-E2の作例とプロンプトが分かる作例集。

generrated.com